第07章 现代卷积神经网络 课堂互动 显示答案 | 返回首页

作者:欧新宇(Xinyu OU)

当前版本:Release v1.0

最后更新:2022-11-23

【课堂互动一】 深度神经网络(AlexNet)@7.11AlexNet和ImageNet简介

1. 以下哪一个模型是第一个卷积神经网络模型?

A. LeNet-5

B. AlexNet

C. VGGNet

D. GoogLeNet

E. ResNet

2. ( )年,AlexNet在Imagenet LSVRC竞赛中获得冠军,这也带来了深度学习的大爆发。

A. 2010

B. 2012

C. 2014

D. 2016

3. Imagenet图像数据集始于2009年,该数据集由 ( ) 领导的团队创建。

A. Alex Krizhevsky 和 Geoffrey Hinton

B. 颜水成

C. 汤晓鸥

D. 李飞飞

4. (多选)在Imagenet大规模视觉识别挑战赛中,下列哪些任务没有使用Imagenet数据集作为官方数据集?

A. 图像分类与目标定位

B. 目标检测

C. 视频目标检测

D. 场景分类

E. 场景分割

5. (多选)以下对于在ILSVRC竞赛中所使用的Imagenet数据集描述正确项包括:()。

A. 包含大约1400万张图像

B. 包含5万张验证集图像

C. 包含大约128万张测试集图像

D. 包含15万张训练集图像

E. 包含1000个类

6. Imagenet LSVRC竞赛从2010年至2017年总共举办了8次,在近三次竞赛中,在分类任务中获得冠军最多的国家(以第一作者的国籍为准)是( )。

A. 中国

B. 美国

C. 加拿大

D. 英国

E. 德国

7. 最早使用卷积神经网络CNN在ILSVRC竞赛中获得冠军的模型是()。

A. LeNet-5

B. AlexNet

C. VGGNet

D. GoogLeNet

E. ResNet

【课堂互动二】 深度神经网络(AlexNet)@7.12AlexNet的网络体系结构

1. (多选)AlexNet最大的贡献是方法论的进化,以下描述出正确的包括()。

A. 特征提取从纯手工向模型自动提取转变

B. 样本的特征选择逐渐由程序员自主选择转变为由领域专家进行设计和选择

C. 使用端到端的设计思路,将特征提取模型及分类器模型合并成一个模型进行同时训练

D. 按照分布设计的思想,将特征提取模型及分类器模型分开进行训练,并将分别训练好的最后模型进行组合输出

2. 设卷积层有m个特征图,则m由()决定?

A. 上一层卷积层的深度

B. 上一层卷积核的个数

C. 上一层卷积核的深度

D. m是超参数由程序员手工设定

3. 为了能实现更好的特征表达能力,除了卷积和池化,卷积神经网络还需要()。

A. 更宽的网络支持

B. 更深的网络

C. 更多的神经元

D. 更大的卷积核

4. 从学习方法来看,Alexnet模型属于()。

A. 监督学习

B. 非监督学习

C. 半监督学习

D. 弱监督学习

5. (多选)在7层模型Alexnet网络中,哪些层包含有最大池化层(Max-Pooling)?

A. 卷积层Conv1

B. 卷积层Conv2

C. 卷积层Conv3

D. 卷积层Conv4

E. 卷积层Conv5

F. 全连接层FC6

G. 全连接层FC7

6. 在卷积神经网络中,全连接层的参数个数的比例通常较高,因此全连接层也是特征学习的主要来源。

A. 正确

B. 错误

7. 在Alexnet网络模型中,全连接层(不含FC8,且只计算单层)的神经元数量为()个。

A. 256

B. 384

C. 1000

D. 2048

E. 4096

8. 在Alexnet模型中,参数最多的一类层是(),最少的一类层是()。

A. 卷积层 池化层

B. 全连接层 池化层

C. 全连接层 卷积层

D. 池化层 卷积层

9. 在Alexnet模型中,输入样本的尺度为[227×227×3],若卷积核的尺度变为[7×7×3],卷积核的步长为2,padding为0,个数为96,则输出特征图的尺度为:()。

A. [55×55×96]

B. [110,110,96]

C. [111,111,96]

D. [111,111,3]

10. 模型的复杂度是用来衡量模型所占用资源的依据,就LeNet和AlexNet来说,下列对模型复杂度描述正确的是()。

A. [55×55×96]

B. [110,110,96]

C. [111,111,96]

D. [111,111,3]

【课堂互动三】 深度神经网络(AlexNet)@7.13AlexNet的技术细节一:数据增广、数据预处理

1. 在Alexnet模型中,一般使用()方式进行均值减除。

A. 逐像素求均值

B. 按色彩通道求均值

C. 按行求均值

D. 按列求均值

2. 观察如下数据预处理的数学表达式,请问哪一项是Alexnet所使用的均值消除方式?

A.

B.

C.

3. (多选)在计算机视觉的任务中,以下属于均值消除带来的优点的包括()。

A. 提高神经网络的收敛速度,从而降低训练时间

B. 降低像素间的相关性,减少模型复杂度,从而实现模型瘦身

C. 降低像素间的相关性,从而提高特征的显著性,进而提高模型的拟合能力

D. 减少噪声数据对模型的影响,从而提高新模型的性能

4. 灰度图和彩色图不同,通常不但需要做均值消除,还需要做标准化处理。

A. 正确

B. 错误

5.(多选)数据增广是基于深度学习任务中非常重要的一个环节,可以有效地解决过拟合问题,使用数据增广的主要原因包括( )。

A. 深度模型的参数太多

B. 相对于深度模型来说,数据太少

C. 深度模型的神经元太多

D. 很多时候数据的多样性不足

6. 在Alexnet模型中,不计算色彩饱和度变换,原始的训练数据被扩展了()倍。

A. 2

B. 10

C. 1024

D. 2048

7. 在Alexnet模型的测试过程中,原始的测试数据被扩展了()倍。

A. 2

B. 10

C. 1024

D. 2048

【课堂互动四】 深度神经网络(AlexNet)@7.14AlexNet的技术细节二:ReLU、Dropout、有重叠池化及LRN

1. 以下常见的激活函数,哪一个收敛速度最快?

A. Sigmoid

B. SoftPlus

C. Tanh双曲正切函数

D. ReLU限制线性单元

2. 下列为了实现保留输入特征图的维度,从而使输出特征图具有和输入特征图一样的维度的技术是哪一个?

A. Convolution

B. Padding

C. Max-Pooling

D. Stride

E. Mean-Pooling

3. (多选)下列技术可以对输出激活实现降采样的有哪些?

A. Convolution

B. Padding

C. Max-Pooling

D. Stride

E. Mean-Pooling

4. 下列哪一项时Dropout的典型值?

A. 0

B. 0.5

C. 0.9

D. 1

5. 以下步长和池化核尺度的关系中,属于有重叠池化的一个是。

A. pool_size = 2, stride = 2

B. pool_size = 2, stride = 3

C. pool_size = 3, stride = 2

D. pool_size = 3, stride = 3

6. 下列选项中,被Alex认为可以通过局部响应归一化实现值域限制来改进性能的激活函数包括()。

A. ReLU

B. Sigmoid

C. Tanh

D. Softmax

【课堂互动五】 深度神经网络(AlexNet)@7.15AlexNet的技术细节三:训练及推理

1. Softmax概率归一化函数的主要功能是实现()。

A. 将神经网络获得的特征值(分值)转换为概率分布

B. 计算网络输出的归一化概率和真是标签之间的交叉熵

C. 获取神经网络输出对应的One-hot向量

D. 获取网络的输出分值

2. 在原始的Alexnet中,作者使用2块GTX 580 GPU来进行训练,在这两个GPU上都有完整的Alexnet模型。

A. 正确

B. 错误

3. GPU并行计算是深度学习模型能够顺利训练的关键因素,目前在模型训练中,最常用的多GPU并行方法是()。

A. 模型并行

B. 参数并行

C. 数据并行

D. 混合并行

4. 在深度学习的训练过程中,有时候会用到多块GPU进行多GPU并行训练,这种方法最大的优势是()。

A. 缩短训练时间

B. 提高训练精度

C. 减少硬盘空间的占用

D. 降低模型对总数据量的需求

5. 在卷积神经网络中,输出层输出的预测标签为输出概率的对数中()的索引。

A. 平均值

B. 最小值

C. 最大值

D. 无法判定

6. 在卷积神经网络中,基于动量的随机梯度下降被广泛使用,其中超参数Momentum的典型值为()。

A. 0

B. 0.5

C. 0.9

D. 1.0

7. (多选)下列哪些项,包含在Alexnet的权重更新规则中?

A. 动量项

B. 权重衰减项

C. 梯度提升项

D. 梯度项

8. (多选)下列多级学习率设计合理的包括()。

A. [0.01, 0.001, 0.0001]

B. [0.0001, 0.001, 0.01]

C. [0.0001, 0.01, 0.001, 0.0001]

D. [0.001, 0.01, 0.001, 0.01]

9. 在AlexNet的训练过程中,基于动量的随机梯度下降被广泛使用,并且使用了步进学习率。即当验证误差趋于平稳,不再下降时,学习率()。

A. 提高100倍

B. 提高10倍

C. 保持不变

D. 降低10倍

E. 降低100倍

10. 下列关于模型结束训练描述正确的是()。

A. 当错误率小于0.01时可以停止训练

B. 需要等待所有轮次训练完才能结束训练

C. 当训练损失仍在下降时不应该结束训练

D. 当验证集损失停止下降时应该结束训练

11. (多选)Alexnet模型的原文中,实现了以下哪些任务?

A. 图像分类

B. 目标检测和识别

C. 图像检索

D. 图像分割

12. 多模型融合一般指使用不同类型的模型结构进行融合,同时使用多个CNN进行融合,一般无法起到提高性能的作用。

A. 正确

B. 错误

13. (多选)在使用卷积神经网络进行图像查询的时候,一般使用()来进行相似性对比。

A. 交叉熵

B. 欧氏距离

C. 汉明距离

D. 贝叶斯概率

14. ZFNet对AlexNet进行了()的优化,并最终获得了ILSVRC2014的冠军,ZFNet也证明了合理的超参数设置对于网络的性能具有很大的影响。

A. 超参数

B. 模型宽度

C. 模型深度

D. 输入图像尺度

【课堂互动六】 模块化的网络(VGGNet)@7.21VGG的特点

1. 以下增加神经网络深度的方法中,VGG所使用的是()。

A. 直接进行更多的全连接层的堆叠

B. 直接进行更多的卷积层的堆叠

C. 精心设计各种功能层的组合

D. 模块化地进行卷积层组的堆叠

2. (多选)VGGNet的一个重要贡献是证明了堆叠小卷积核比使用大卷积核具有更多的优势,这些优势包括()。

A. 可以获得更深的网络,即得到更强的非线性特性

B. 减少参数,从而降低模型对存储的需求

C. 缩小特征图尺度,降少计算量

D. 增强神经元的强度,从而提高神经网络的判别能力

3. VGGNet中小卷积核起到了至关重要的作用,下列维度的卷积核哪一个是标准VGG16中最主要的卷积核。

A. [5×5]

B. [4×4]

C. [3×3]

D. [2×2]

E. [1×1]

4. 堆叠3个3×3的卷积层,可以获得与()的卷积层一样的感知域。

A. 5×5

B. 7×7

C. 9×9

D. 11×11

【课堂互动七】 模块化的网络(VGGNet)@7.22VGG架构的详细分析

1. 在基于VGG模型的卷积神经网络中,大多数的内存主要消耗在()。

A. 低层的卷积层

B. 高层的卷积层

C. 高层的全连接层

D. 低层的池化层

E. 高层的池化层

2. 在基于VGG模型的卷积神经网络中,大多数的参数主要位于()。

A. 低层的卷积层

B. 高层的卷积层

C. 高层的全连接层

D. 低层的池化层

E. 高层的池化层

3. 在VGGNet中,作者验证了在AlexNet中提出的局部正则响应层(LRN)能够有效地提高模型的辨别能力。

A. 正确

B. 错误

4. VGGNet的成功证明了,对模型进行()的增加能够有效提高模型的识别能力。

A. 宽度

B. 深度

C. 通道数

D. 特征图尺度

【课堂互动八】 多分支网络(GoogLeNet)@7.31网络中的网络

1. 在卷积神经网络中,大多数参数来源于()。

A. 卷积层

B. 卷积层与池化层之间

C. 卷积层与全连接层的交接处

D. 全连接层

2. 在NiN网络中,1×1卷积的功能包括()。

A. 增加模型的非线性性

B. 提供更多种类的特征,即增加特征的多样性

C. 对单通道特征进行融合,生成复合特征

D. 减少网络的参数数量

3. 在NiN网络中,使用了以下哪些功能层?

A. 平均池化层(Mean-Pooling)

B. 最大池化层(Max-Pooling Layer)

C. 卷积层(Convolution Layer)

D. 全局平均池化层(Global Average Pooling Layer)

E. 全连接层(Fully-Connection Layer)

4. [多选] 以下对神经网络模型特性的描述种,符合NiN模型的包括()。

A. 随着网络深度的加深,特征图的尺度逐渐变大

B. 语义信息越强的层次,特征通道数量越多

C. 交替使用NiN网络和最长为3的最大池化层来构建模型

D. NiN模型使用全卷积架构来实现特征提取,因此除最后的Softmax外,只存在卷积层

E. NiN模型最重要的设计初衷是解决全连接层参数过多的问题

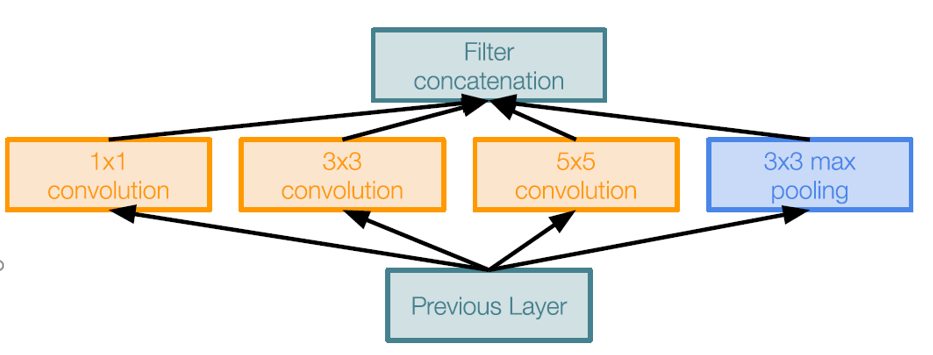

【课堂互动九】 多分支网络(GoogLeNet)@7.32Inception

1. GoogLeNet使用并行的思路设计了Inception模块,并联了多个不同感知域的卷积层和池化层,这种方法有效组合了不同视野下特征,起到了特征互补的作用。

A. 正确

B. 错误

2. 在GoogLeNet中,使用1×1卷积的瓶颈设计通过减少特征通道的数量,实现了()。

A. 计算复杂性的降低

B. 参数数量的减少

C. 模型判别能力的提高

D. 模型结构的简化

3. 在GoogLeNetV1的Inception模块中,融合了以下哪几种尺度的卷积层?

A. 1×1卷积

B. 3×3卷积

C. 5×5卷积

D. 7×7卷积

E. 11×11卷积

4. 以下以卷积为核心的功能层/模块中,计算复杂度最高(FLOPS)的模块和最低的模块分别是()。

A. 3×3卷积 基本Inception模块

B. 5×5卷积 基本Inception模块

C. 3×3卷积 带瓶颈设计的Inception模块

D. 5×5卷积 带瓶颈设计的Inception模块

5. 以下对计算复杂度描述正确的公式包括(),其中K表示卷积核,F表示特征图,in_channel表示输入通道,out_channel表示输出通道,N=Numbers表示数量。

A. 参数数量 = Kwidth × KHeight × Nin_channels × Nout_channels

B. 参数数量 = Kwidth × KHeight × KDepth × NKernels

C. FLOPS = (Kwidth × KHeight × KDepth) × NKernels × (FWidth × FHeight × FDepth)

D. FLOPS = (Kwidth × KHeight × KDepth) × NKernels × (FWidth × FHeight)

【课堂互动十】 多分支网络(GoogLeNet)@7.33GoogLeNet体系结构详解及其变种

1. 下列模型中,参数数量最少的模型是()。

A. AlexNet

B. VGGNet

C. GoogLeNet

D. ResNet

2. VGGNet和GoogLeNet模型的设计都没有超过30层,这有利的证明了深度学习中的“深度”的上限不超过30层。

A. 正确

B. 错误

3. 在标准的GoogLeNetV1中总共包含()层(有权重参数的层)。

A. 16

B. 19

C. 22

D. 37

4. 在GoogLeNet中,前后两个相邻的卷积层组的特征图尺度间的关系是()。

A. 尺度保持不变

B. 尺度缩小一半

C. 尺度放大一倍

D. 无法确定

【课堂互动十一】 深度残差网络(ResNet)@7.4

1. 深度模型的深度"失效"的主要原因是()。

A. 过拟合

B. 欠拟合

C. 优化困难

D. 更深的模型意义不大

2. 下列模型中,哪一个模型证明了深度学习的“深度”并没有失效,并且将深度学习真正推到超过1000层的深度。

A. AlexNet

B. VGGNet

C. GoogLeNet

D. ResNet

3. (多选)下列模型中,哪些模型利用1×1卷积来实现瓶颈设计。

A. AlexNet

B. VGGNet

C. GoogLeNet

D. ResNet

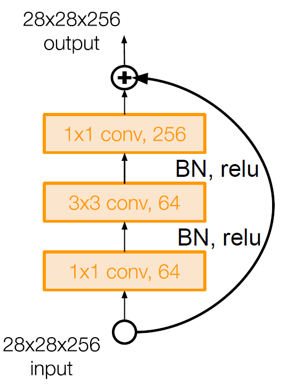

4. 观察下列结构,哪一个(哪些)属于残差模块。

|

|

|

|

| A | B | C | D |

5. 以下科学家,哪一位是ResNet的主要设计者?

A. Alex Krizhevsky

B. Christian Szegedy

C. Karen Simonyan

D. Kaiming He

6. 在残差结构公式 H(x) = F(x) + x 中,表示残差一项是()。

A. F(x)

B. H(x)

C. x

D. F(x)+x

【课堂互动十二】 蓬勃发展的卷积神经网络@7.5

1. (多选)下列模型中,除了分类用的全连接层,没有其他的全连接层的模型包括()。

A. AlexNet

B. VGGNet

C. GoogLeNet

D. ResNet

2. (多选)随着ResNet以及各种基于残差网络的编制卷积神经网络模型被设计出来,CNN结构的研究方向已经从提高精度向提高计算效率等方向转变,下列模型中,更适合于移动设备的模型包括()。

A. SENet

B. MobileNet

C. ShuffleNet

D. DenseNet

3. 下列模型中,参数最多的是()。

A. VGGNet

B. ResNet

C. GoogLeNet

D. AlexNet

4. 下列模型中,执行效率最高的是()。

A. VGGNet

B. ResNet

C. GoogLeNet

D. AlexNet

5. 下列模型中,综合性能最好的是()。

A. VGGNet

B. ResNet

C. GoogLeNet

D. AlexNet